LReLU、ELU、maxout 等激活函数 sigmoid函数的梯度随着x的增大或减小和消失,而ReLU不会。ww的存在,所以ww的大小影响了梯度的消失和爆炸,Batch Normalization 就是通过对每一层的输出规范为均值和方差一致的方法LSTM 全称是长短期记忆网络 首次在image大赛推出的深度学习模型是哪个?Alex net 2012年冠军,成为第一个应用深度神经网络的应用 循环神经网络的循环是指什么?正则化其实是一种策略,以增大训练误差为代价来减少测试误差的所有策略我们都可以称作为正则化。

感谢七年期限同学的提醒,认证考试入口:https://aistudio.baidu.com/aistudio/certification 看了下条件,没有太多限制,配套课程好像就是毕老师的百度架构师手把手教深度学习入门课:企业员工或社会人士,具备相关行业2~5年工作经验 基本要求: 1.能对自然语言处理、计算机视觉、语音三大领域中的任一类任务,通过调优使得该任务上的模型达到特定的需求指标能对中等应用问题进行选型、设计指标完成全流程构建并解决问题 认证方式:在线编程进行模型训练,由百度飞桨和

2018年10月,百度联合深度学习技术及应用国家工程实验室、中国软件行业协会,共同发布国内第一个深度学习工程师能力评估标准并于2019年3月,向社会开放“深度学习工程师”认证考试。当咱这么多年“三长一短选一短、三短一长选一长、实在不会就选C”的考试技能都荒废了吗?场外视角了解一下: 一共50道选择题,每题2分,右上角会有一个90分钟的倒计时。结合考试体会,简单拆分一下深度学习工程师的技能树: 个人感觉,初级对应的基础理论和知识面比较广泛,更适合在校学生与毕业一两年的工程师和开发者报考

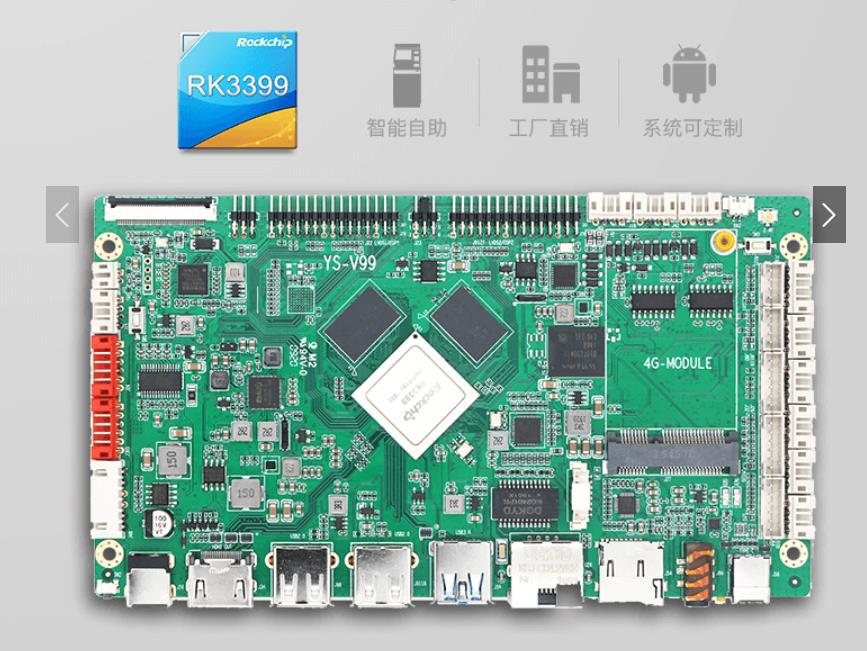

本产品为智能安卓主板完美适配类工控接口需求,该产品在新 零售、智慧收银、智慧政务、智能自助快递柜及智慧共享行业等领域有着广泛的应用场景。

¥819 /件

图像主图识别api中调用超过每天500次会怎样?我在文档上面只看到了文字识别和图像识别的收费标准,没有看到图像识别的收费标准,但是图像识别是每天会有限制500次的,如果每天调用超过500次。

AudioFlinger: BUFFER TIMEOUT: remove(4097) from active list on thread...

我没有国内的手机号,请问该怎么用国外的手机号怎么注册开发者账户?

公司用的开发板,项目中集成了人脸识别,每次安装项目设备指纹都会变化,请问有什么办法解决吗?

共 16357 条

- 1

- 2

- 3

- 4

- 5

- 6

- 818

跳至

确定

QQ支持群

百度语音:588369236

文字识别:1055623827

自定义模板OCR:1055402721

人脸识别:692450852

人体分析:860337848

内容审核:375765194

飞桨PaddlePaddle:778260830

图像识别:312156782

EasyDL:614951239

图像搜索:1067276154

视频分析:632473158

百度AR:472081119

自然语言:1051436514

UNIT:1074410189

百度翻译:214857706

图像效果增强:1092338829

数据智能:650596829

知识图谱:655854786

DuerOS:604592023

百度AI开放平台:224994340

智能写作:743926523

EdgeBoard:1060623352

语音自训练平台:686267521

远场语音开发套件:210093204

×

技术能力

语音技术

文字识别

人脸与人体

图像技术

语言与知识

视频技术

度目场景方案

AI中台

生态合作计划

开发平台

场景应用

度目智能安防

度目智慧教育

智能制造

智能零售

体验AI

Web端 前往AI能力体验中心

移动端 打开百度APP“扫一扫”