利用原有/新建监控网络,订制化管理软件,选择关键点摄像头,捕捉人脸,通过后台百度AI识别,生成教职工的考勤和校内轨迹数据

¥39万 /套起

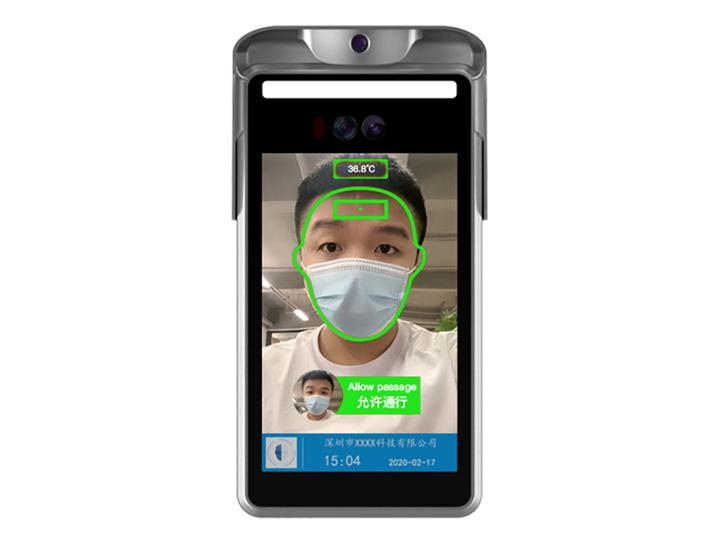

疫情当前,人脸识别的考勤和门禁更能让人员放心,设备在无感开门后实现了智能考勤的统计,门禁即考勤,减少员工打卡次数

¥2999 /套

视觉定位区别于 GPS定位,通过采集摄像头及其他传感器数据并进行深度融合,返回信息维度更多的六自由度位姿信息(包含三维位置信息和朝向信息),可覆盖部分室内或室外场景的精准定位并支持虚拟内容的精准叠加显示;通过分析处理用户采集的场景视频数据,构建场景的高精度三维地图并存储在云端,为用户提供高精度定位能力以及设计虚实融合场景时的可视化参考模型

来自:产品

可满足多种班次同时使用,可执行固定班和规律排班自由组合,可对统计工时做多重处理,排班和统计以图表形式展示其他功能优于主流考勤系统

¥4000 /套

LReLU、ELU、maxout 等激活函数 sigmoid函数的梯度随着x的增大或减小和消失,而ReLU不会。2使用批规范化 通过规范化操作将输出信号xx规范化到均值为0,方差为1保证网络的稳定性.从上述分析分可以看到梯度裁剪:主要针对梯度爆炸问题,设置一个阈值,当梯度查过这个阈值之后将它限制在这个范围之内。 5.LSTM 全称是长短期记忆网络 首次在image大赛推出的深度学习模型是哪个?L2和L1正则化的区别 正则化的目的是限制参数过多或者过大,避免模型更加复杂 使用L1范数,可以使得参数稀疏化

不仅人工智能领域与有荣焉,也让深度学习算法工程师这个职业备受关注。深度学习到底需不需要证书保驾护航?工程师认证值不值得考?又该怎么考?那么,深度学习工程师认证到底都考察哪些能力呢?(计划)从业者们又是如何看待职业认证的?中文平台和认证标准还需要持续发力,百度深度学习工程师认证体系的打造,对此确实能起到一定的助推作用。但可预见的是,随着人工学习神经网络成为社会的基础设施,我们必然需要越来越多的深度学习工程师来保驾护航。

将百度人脸检测、搜索、活体等技术和原有考勤机相结合,使设备升级为智能人脸考勤机,以人易宝企业平台为云管理依托,进行人员考勤的管理。

¥10 /套起

共 51187 条

- 1

- 2

- 3

- 4

- 5

- 6

- 2560

跳至

确定

QQ支持群

百度语音:588369236

文字识别:1055623827

自定义模板OCR:1055402721

人脸识别:692450852

人体分析:860337848

内容审核:375765194

飞桨PaddlePaddle:778260830

图像识别:312156782

EasyDL:614951239

图像搜索:1067276154

视频分析:632473158

百度AR:472081119

自然语言:1051436514

UNIT:1074410189

百度翻译:214857706

图像效果增强:1092338829

数据智能:650596829

知识图谱:655854786

DuerOS:604592023

百度AI开放平台:224994340

智能写作:743926523

EdgeBoard:1060623352

语音自训练平台:686267521

远场语音开发套件:210093204

×

技术能力

语音技术

文字识别

人脸与人体

图像技术

语言与知识

视频技术

度目场景方案

AI中台

生态合作计划

开发平台

场景应用

度目智能安防

度目智慧教育

智能制造

智能零售

体验AI

Web端 前往AI能力体验中心

移动端 打开百度APP“扫一扫”