ERNIE-Layout介绍

ERNIE-Layout

基本介绍

随着众多行业的数字化转型,电子文档的结构化分析和内容提取成为一项热门的研究课题。电子文档包括扫描图像文件和计算机生成的数字文档两大类,涉及单据、行业报告、合同、雇佣协议、发票、简历等多种类型。智能文档理解任务以理解格式、布局、内容多种多样的文档为目标,包括了文档分类、文档信息抽取、文档问答等任务。与纯文本文档不同的是,文档包含表格、图片等多种内容,包含丰富的视觉信息。因为文档内容丰富、布局复杂、字体样式多样、数据存在噪声,文档理解任务极具挑战性。 随着ERNIE等预训练语言模型在NLP领域取得了巨大的成功,人们开始关注在文档理解领域进行大规模预训练。百度提出跨模态文档理解模型 ERNIE-Layout,首次将布局知识增强技术融入跨模态文档预训练,在 4 项文档理解任务上刷新世界最好效果,登顶 DocVQA 榜首。同时,ERNIE-Layout 已集成至百度智能文档分析平台 TextMind,助力企业数字化升级。

ERNIE-Layout

原理介绍

对文档理解来说,文档中的文字阅读顺序至关重要,目前主流的基于 OCR(Optical Character Recognition,文字识别)技术的模型大多遵循「从左到右、从上到下」的原则,然而对于文档中分栏、文本图片表格混杂的复杂布局,根据 OCR 结果获取的阅读顺序多数情况下都是错误的,从而导致模型无法准确地进行文档内容的理解。

而人类通常会根据文档结构和布局进行层次化分块阅读,受此启发,百度研究者提出在文档预训模型中对阅读顺序进行校正的布局知识增强创新思路。TextMind 平台上业界领先的文档解析工具(Document Parser)能够准确识别文档中的分块信息,产出正确的文档阅读顺序,将阅读顺序信号融合到模型的训练中,从而增强对布局信息的有效利用,提升模型对于复杂文档的理解能力。

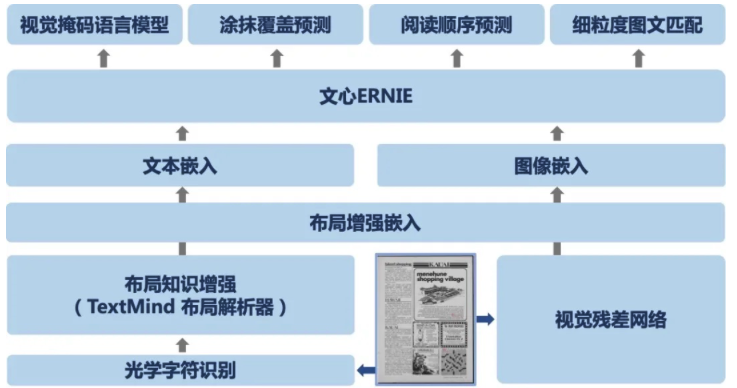

基于布局知识增强技术,同时依托文心 ERNIE,百度研究者提出了融合文本、图像、布局等信息进行联合建模的跨模态通用文档预训练模型 ERNIE-Layout。如下图所示,ERNIE-Layout 创新性地提出了阅读顺序预测和细粒度图文匹配两个自监督预训练任务,有效提升模型在文档任务上跨模态语义对齐能力和布局理解能力。

适用场景

针对带布局数据(文档、图片等)的文档分类、信息抽取、文档问答等任务。

英文模型效果

| method | FUNSD(F1) | CORD(F1) | SROIE(F1) | Kleister-NDA(F1) | RVL-CDIP(Accuracy) | DocVQA(ANLS) |

|---|---|---|---|---|---|---|

| LayoutLMv2 | 84.20 | 96.01 | 97.81 | 85.2 | 95.64 | 86.72 |

| LAMBERT | - | 94.41 | 98.17 | 80.42 | - | - |

| TILT | - | 96.33 | 98.10 | - | 95.52 | 87.05 |

| ERNIE-Layout | 93.12 | 97.21 | 97.55 | 88.10 | 95.41 | 88.41 |

中文模型效果

| method | XFUNSD(F1) | EPHOIE(F1) |

|---|---|---|

| TRIE | - | 93.21 |

| VIES | - | 95.23 |

| MatchVIE | - | 96.87 |

| LayoutXLM | 89.73 | - |

| ERNIE-Layout | 89.88 | 98.67 |